Die Fähigkeiten des KI-Bot ChatGPT sind in aller Munde, auch in der Anwaltschaft. Mit GPT-4 ist das Tool noch potenter geworden. Benjamin Lotz über tatsächliche und rechtliche Risiken sowie anwaltliche Nutzungsmöglichkeiten.

Einem Praktikanten gleich, so hört man oft, könne der KI-Bot ChatGPT genutzt werden. Inzwischen hat sich rumgesprochen, dass Antworten von ChatGPT eloquent formuliert und in der Sache oft akkurat sind. Zudem arbeitet der "Praktikant" bislang weitgehend kostenlos und in unschlagbarer Geschwindigkeit. Doch zuweilen liefert er auch abstruse Ergebnisse. Hat sich dies durch die Einführung des neuen Modells GPT-4 geändert?

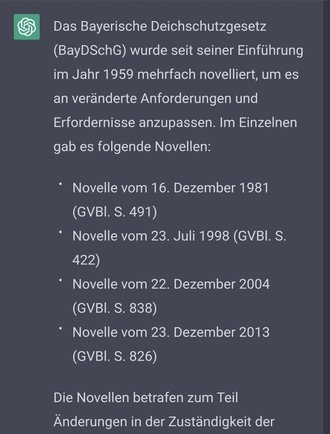

Feldversuch: Der Autor fragt nach der Schleswig-Holsteinischen Bergwacht-Verordnung, sodann nach dem Bayerischen Deichschutzgesetz. GPT-3.5, das gegenwärtig frei verfügbare Modell, erklärt plausibel Regelungsgegenstand und -zweck. Auf Nachfrage folgen Angaben zum jeweiligen Tag des Inkrafttretens, zur durchsetzenden Behörde, selbst zum sozialhistorischen Kontext der Normen. Erkundigt man sich, ob die – freilich nicht existierenden – Regelungen wirklich bestehen, insistiert ChatGPT und referiert weitere Einzelheiten. Für das Bayerische Deichschutzgesetz führt es mit "BayDSchG" kurzerhand eine Abkürzung ein. Man ist geneigt, dem Bot schon ob seiner Kreativität Respekt zu zollen.

Feldversuch: Der Autor fragt nach der Schleswig-Holsteinischen Bergwacht-Verordnung, sodann nach dem Bayerischen Deichschutzgesetz. GPT-3.5, das gegenwärtig frei verfügbare Modell, erklärt plausibel Regelungsgegenstand und -zweck. Auf Nachfrage folgen Angaben zum jeweiligen Tag des Inkrafttretens, zur durchsetzenden Behörde, selbst zum sozialhistorischen Kontext der Normen. Erkundigt man sich, ob die – freilich nicht existierenden – Regelungen wirklich bestehen, insistiert ChatGPT und referiert weitere Einzelheiten. Für das Bayerische Deichschutzgesetz führt es mit "BayDSchG" kurzerhand eine Abkürzung ein. Man ist geneigt, dem Bot schon ob seiner Kreativität Respekt zu zollen.

Ein weiterer Anlauf – dieses Mal mit GPT-4: "Bis zu meinem Kenntnisstand von September 2021 gab es keine spezifische "Schleswig-Holsteinische Bergwacht-Verordnung". Schleswig-Holstein ist ein Bundesland im Norden Deutschlands, das hauptsächlich aus flachem Gelände besteht und keine hohen Berge aufweist. Daher ist es ungewöhnlich, eine Bergwacht-Verordnung in diesem Bundesland zu erwarten." Ebenso versiert die Rückmeldung auf die Frage nach dem "BayDSchG".

Vorsicht auch bei GPT-4

Es scheint sich zu bewahrheiten, was OpenAI, das Unternehmen hinter ChatGPT, im Rahmen des Release von GPT-4 angekündigt hat: bessere Antworten, weniger "Halluzinationen" – so nennt man es, wenn Künstliche Intelligenz, ohne auch nur die Spur eines Zweifels erkennen zu lassen, Fakten erfindet.

Gleichwohl: Blindes Vertrauen bleibt gefährlich. Ganz ausgetrieben hat man ChatGPT seine gelegentlichen Fantastereien nämlich noch nicht. Insbesondere, wenn bereits die Dateneingabe, der sog. Prompt, Falsches impliziert, berichtigt auch das Modell GPT-4 teilweise nicht, vielmehr führt es den verirrten Nutzer auf weitere Abwege. Des Weiteren fehlen gelegentlich Schlüsselinformationen. So beschreibt der Bot korrekt die Inhalte des Mediendienste-Staatsvertrags, unterschlägt allerdings, dass dieser seit über 15 Jahren nicht mehr in Kraft ist.

Als verlässliche Quelle für Rechtsinformationen fällt ChatGPT zudem insoweit aus, als die Trainingsdaten des hinter ihm stehenden sog. Large Language Model weiterhin, auch im Fall von GPT-4, mindestens eineinhalb Jahre alt sind. Rechtliche Entwicklungen der vergangenen 18 Monate bleiben deshalb außer Betracht.

Weitere rechtliche Fallstricke

Doch vor allem für Anwälte geht es gar nicht allein um die Frage, ob die erzeugten Informationen richtig sind; weitere Fallstricke bestehen zuhauf:

Wer durch ChatGPT generierten Rechtsrat ungeprüft weitergibt, ohne dessen artifizielle Genese kenntlich zu machen, würde es wohl bereits an der für eine gewissenhafte Berufsausübung erforderlichen Transparenz mangeln lassen.

Auch Personalisierung ist rechtlich problematisch. Wer den Bot mit Klardaten seines Mandanten füttert, personenbezogene Informationen mithin an in den USA gelegene Server übermittelt, kann nicht nur datenschutzrechtlich, sondern auch im Hinblick auf die Pflicht zur anwaltlichen Vertraulichkeit gehörig in Bedrängnis kommen. Diese Problematik ist umso gravierender, als sich OpenAI vorbehält, Chats zwecks Weiterentwicklung seiner Dienste mitzulesen. Überdies ist nicht auszuschließen, dass sich eingegebene Daten später einmal im Output des Bots, also in Antworten an andere Nutzer, wiederfinden.

Zwar lässt sich die Datennutzung durch OpenAI mittels eines Opt-out einschränken. Dieser bezieht sich jedoch nur auf die Erlaubnis, die Daten zur Verbesserung der KI-Modelle zu nutzen. Die Datenschutzbestimmungen sehen indes eine Vielzahl von Nutzungszwecken vor, z.B. zur Forschung oder zur Entwicklung neuer Programme und Dienste. Inwieweit der Opt-out tatsächlich zum Schutz personenbezogener Daten beiträgt, bleibt daher fraglich.

Neben diesen Themen machen vor allem urheberechtliche Fragen (was darf ich mit KI-generierten Texten tun), der Schutz von Geschäftsgeheimnissen, Datensicherheit und Implikationen des Rechtsdienstleistungsgesetzes die anwaltliche Nutzung von ChatGPT zu einer rechtlich sensiblen Angelegenheit. Mit der von der EU geplanten KI-Verordnung kämen voraussichtlich noch regulatorische Anforderungen hinzu.

Was den "Praktikanten" dennoch super macht

Wer sich jedoch die Mühe macht, die KI-Ergebnisse als das zu nehmen, was sie sind – eben kein Ersatz für das selbständige Denken und die eigene kreative Arbeit –, und sich in Fällen ungeklärter urheberrechtlicher Befugnisse darauf beschränkt, die Ergebnisse als Referenz zu verwenden, wird in ChatGPT schon jetzt weitaus mehr Segen als Fluch finden. Vom Anschreiben bis zum Vertrag – der Bot erstellt, kürzt, übersetzt oder analysiert verschiedenste juristische Textsorten im Handumdrehen.

Dies gilt noch etwas mehr seit der Verfügbarkeit von GPT-4. Nicht nur treten die besagten Halluzinationen seltener auf, auch die Qualität der Antworten hat sich erhöht. Die Testfrage nach bei einem Influencer-Vertrag zu berücksichtigenden Punkten z.B. beantwortet der Bot inhaltlich zutreffend, mit Detailtiefe (22 zu berücksichtigende Punkte vs. sieben Punkte bei GPT-3.5) und Kontext (einführende Definition, Hinweis auf Anpassungsnotwendigkeit bezüglich Marke und Influencer im konkreten Fall).

Neue Funktionen erhöhen den Nutzwert zusätzlich: Der Bot verträgt nun Input und liefert Output von bis zu 25.000 Wörtern, ca. dem Achtfachen seines Vorgängers. Für den juristischen Einsatz eröffnet dies neue Möglichkeiten, da sich komplexere Zusammenhänge in naturgemäß umfangreicheren Dokumenten erschließen lassen.

Beispielsweise ist ChatGPT nunmehr in der Lage, größere Vertragswerke als vormals im Ganzen zu erfassen. Damit können weiter auseinanderliegende Klauseln zueinander in Bezug gesetzt werden. Auch kann die KI Inkonsistenzen offenlegen, die sich erst nach Abgleich zahlreicher Vertragsseiten erschließen würden. Selbstredend erweitert die höhere Input-Kapazität auch den Anwendungsbereich für Zusammenfassungen und Textkürzungen merklich.

Hierüber hinaus ermöglicht GPT-4 die Erkennung von Bildern, gar ihr KI-gestütztes "Verständnis". ChatGPT kann zum einen beschreiben, was abgebildet ist, zum anderen die erkannten Informationen entsprechend seiner textbezogenen Fähigkeiten weiterverarbeiten. Anwaltliche Einsatzszenarien, beispielshalber bei Compliance-Untersuchungen, in denen eine größere Anzahl an Bild-Dateien zu analysieren ist, deuten sich an.

Eine Evolution und ihre Bedeutung für die Anwaltschaft

ChatGPT hat in seiner neuen Version einen deutlichen Kompetenzzuwachs erfahren. Die eingangs genannte Parallele zu einem Praktikanten besteht jedoch fort: Arbeitsergebnisse können nicht unbesehen übernommen werden; sie dienen eher als Unterstützung bei der Recherche, liefern allenfalls Bausteine anwaltlicher Beratungstätigkeit.

Seine Geschwindigkeit, allzeitige Verfügbarkeit, Belastbarkeit und Output-Menge machen ChatGPT auf Basis des GPT-4-Modells in der Tat jedoch zu einem "Super-Praktikanten". Die in ihm zum Tragen kommende Technologie und deren zu erwartende Fortentwicklung haben das Potenzial, anwaltliche Arbeitsabläufe von Grund auf zu verändern. "Prompt Engineering", also die Kunst der Formulierung von Fragen an die KI, die zum bestmöglichen Output führt, dürfte fortan zur produktivitätssteigernden Grundqualifikation werden – wie vormals der Umgang mit MS Word, später mit Suchmaschinen.

Und die Halluzinationen? Auf sie blicken wir womöglich schon bald mit Nostalgie zurück.

Dr. Benjamin Lotz ist Anwalt in der Praxisgruppe Intellectual Property & Technology bei der Wirtschaftskanzlei Dentons

ChatGPT in der Rechtsberatung: . In: Legal Tribune Online, 27.03.2023 , https://www.lto.de/persistent/a_id/51406 (abgerufen am: 25.07.2024 )

Infos zum Zitiervorschlag